在首届Microsoft Secure活动中宣布,该公司透露Microsoft Security Copilot由GPT-4生成多模式AI驱动。在随附的博客文章中,该公司表示,新平台将有助于正面应对网络犯罪分子,使组织领先一步,而不是不断追赶威胁行为者。

“今天,网络安全专业人员的胜算仍然很大。很多时候,他们与多产、无情和老练的攻击者进行不对称的战斗。为了保护他们的组织,防御者必须应对通常隐藏在噪音中的威胁。使这一挑战更加复杂的是全球熟练安全专业人员的短缺,导致该领域估计有3万个职位空缺。

安全Copilot将弥补技能短缺的不足,同时还在机器速度水平上提供可扩展和不断发展的端到端防御。微软将该解决方案描述为第一个利用ChatGPT自然语言模型(LLM)和微软现有安全特定AI的解决方案。

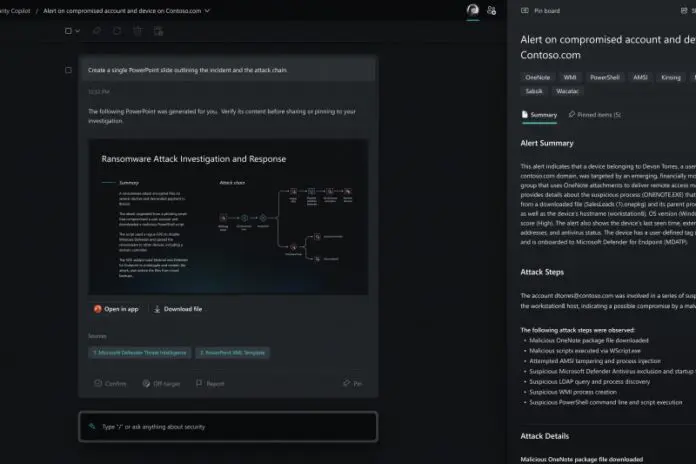

“当Security Copilot收到来自安全专业人员的提示时,它会利用特定于安全的模型的全部功能来部署技能和查询,从而最大限度地提高最新大型语言模型功能的价值。这是安全用例所独有的。我们的网络训练模型增加了一个学习系统来创造和调整新技能。然后,Security Copilot可以帮助发现其他方法可能遗漏的内容,并增强分析师的工作。

微软承认该系统并不完美,仅仅是因为人工智能仍然是一种不断发展的技术,会犯错误。为了克服这个问题,Microsoft Security Copilot使用了一个闭环学习系统。这实质上意味着它不断从用户交互中学习,并欢迎反馈以帮助它改进。

增强安全性

值得注意的是,微软并未将Security Copilot定位为当前网络安全措施的完全替代品。我相信这是最终目标,但人工智能远未准备好承担这种责任。相反,微软表示,该服务通过机器规模和速度增强了当前的安全专业人员。

该公司指出,该系统仍然依赖于“人类的聪明才智”,并建立在三个指导原则之上:

- “简化复杂性:在安全方面,分秒必争。借助 Security Copilot,防御者可以在几分钟内响应安全事件,而不是几小时或几天。Security Copilot 通过基于自然语言的调查体验提供关键的分步指导和上下文,从而加快事件调查和响应速度。快速总结任何流程或事件并调整报告以适应所需受众的能力使维护者能够专注于最紧迫的工作。

- 抓住其他人错过的东西:攻击者躲在噪音和微弱信号后面。防御者现在可以发现原本可能未被发现的恶意行为和威胁信号。Security Copilot 实时显示威胁的优先级,并通过基于 Microsoft 全球威胁情报的持续推理来预测威胁参与者的下一步行动。Security Copilot 还具备代表安全分析师在威胁搜寻、事件响应和漏洞管理等领域的专业知识的技能。

- 解决人才缺口:安全团队的能力将始终受到团队规模和人类注意力的自然限制的限制。Security Copilot 能够回答与安全相关的问题(从基本到复杂),从而提高防御者的技能。Security Copilot 不断从用户交互中学习,适应企业偏好,并就最佳行动方案向防御者提供建议,以实现更安全的结果。它还支持新团队成员的学习,因为它使他们在发展过程中接触到新的技能和方法。这使安全团队能够事半功倍,并利用更大、更成熟的组织的能力运营。

能力

不仅仅是OpenAI的GPT-4定义了Microsoft Security Copilot。该服务还直接利用 Microsoft 特定于安全的 AI 和端到端服务来提供以下功能集:

- “持续访问最先进的OpenAI模型,以支持最苛刻的安全任务和应用程序

- 一个特定于安全的模型,受益于持续的强化、学习和用户反馈,以满足安全专业人员的独特需求;

- 由组织的安全产品和 Microsoft 每天看到的 65 万亿个威胁信号提供支持的可见性和常青威胁情报,以确保安全团队使用攻击者及其策略、技术和过程的最新知识进行操作;

- 与 Microsoft 的端到端安全产品组合集成,以安全信号为基础提供高效的体验;

- 越来越多的独特技能和提示提升了安全团队的专业知识,并为即使在资源有限的情况下也能实现的目标设定更高的标准。

安全

Microsoft Security Copilot 的目的是开创 AI 驱动安全的新时代。但另一方面,微软正在做些什么来确保人工智能是合乎道德的。考虑到该公司本月解雇了其人工智能道德团队,这是一个热门话题,并且还没有真正做足够的工作来讨论它正在释放到野外的人工智能的潜在危险。

首先,OpenAI是最近几个月所有微软AI项目的锚点。OpenAI 是一个认真对待 AI 道德并拥有强大安全承诺的组织。微软在Security Copilot上仍然含糊不清,只是说它坚持承诺“通过负责任的创新,赋予他人权力,并促进积极影响,实现有影响力和负责任的人工智能实践”。

该公司确实指出,该服务的用户可以控制其数据的使用方式和时间。此外,微软声称用户数据不用于教授AI模型。

微软的AI激增

最近几个月,人工智能(AI)经历了主流爆炸式增长。这主要是由微软和OpenAI推动的,它们是微软通过数十亿美元的投资的长期合作伙伴。我们经常被告知,人工智能将改变我们的生活,并从根本上改善生活。在大多数情况下,微软近几个月对人工智能的拥抱已经朝着这个方向推动了方向,但只是轻微的。

在网络安全中使用人工智能是该技术可以快速变革的领域。这就是为什么Microsoft 365 Copilot是GPT-4的有趣用途。