在不断发展的人工智能 (AI) 世界中,有很多关于我们应该如何构建和共享 AI 技术的讨论。经常讨论两种主要方法:开源 AI 和专有 AI。最近的一项实验将名为 Orca-2-13B 的开源 AI 模型与名为 GPT-4 Turbo 的专有模型进行了比较,引发了一场激烈的辩论。这场争论不仅仅是关于哪种模型更好,而是关于每种方法对人工智能的未来意味着什么。

开源 AI 模型 Orca-2-13B 是透明度、协作和创新的光辉典范。开源 AI 就是分享代码和想法,以便每个人都可以共同努力,让 AI 变得更好。这种方法认为,当我们让人工智能技术向所有人开放时,我们创造了一个空间,任何拥有合适技能的人都可以帮助改进它。开源 AI 的一大优点是,您可以看到 AI 如何做出决策,这对于信任 AI 系统非常重要。此外,开源 AI 受益于 GitHub 等社区,来自各地的开发人员可以在这里协同工作,使 AI 模型变得更好。

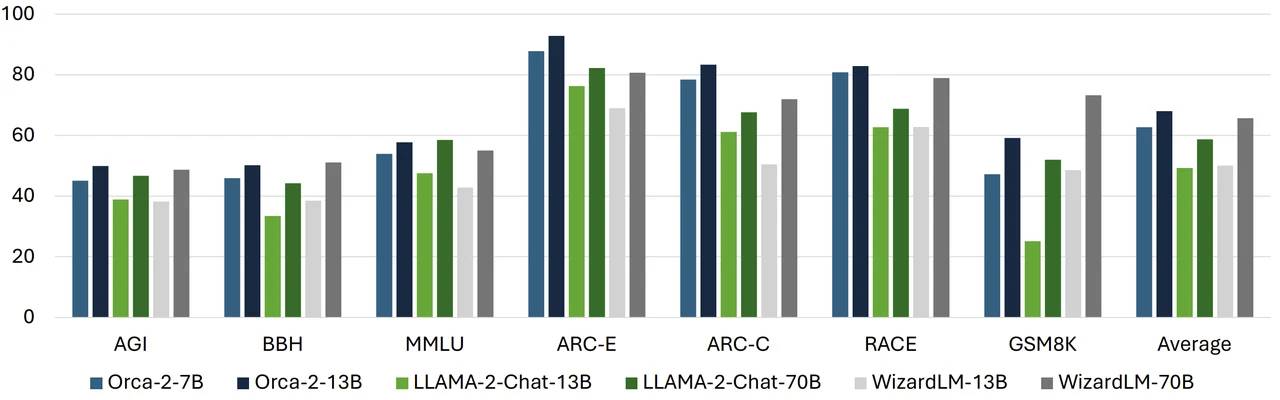

Orca 2是Microsoft探索小型LM功能(大约100亿个参数或更少)的最新进展。在 Orca 2 中,它证明了改进的训练信号和方法可以使较小的语言模型能够实现增强的推理能力,这通常只存在于更大的语言模型中。

另一方面,我们有专有的人工智能,比如 GPT-4 Turbo,它专注于安全、投资和问责制。专有人工智能通常由在研发上花费大量资金的公司制造。他们认为,这项投资是使人工智能更智能、更有能力的关键。使用专有 AI,代码不会公开共享,这有助于防止其以错误的方式使用。制造专有人工智能的公司还负责确保人工智能运行良好并符合道德标准,这对于确保人工智能安全有效非常重要。

GPT-4 Turbo 与 Orca-2-13B

- Orca-2-13B(开源 AI)

- 重点:强调透明度、协作和创新。

- 优势:

- 鼓励广泛参与和想法分享。

- 通过透明的决策过程增加信任。

- 通过允许公共投入和改进来促进创新。

- 挑战:

- 分散工作和资源稀释的可能性。

- 如果没有结构化的监督,质量保证可能会不一致。

- GPT-4 Turbo(专有 AI)

- 重点:专注于安全、投资和问责制。

- 优势:

- 更高的投资会带来先进的研发。

- 加强对 AI 的控制,确保安全性和道德合规性。

- 更一致的质量保证和产品改进。

- 挑战:

- 由于闭源性质,可访问性和协作性有限。

- 由于决策缺乏透明度,可能会引起怀疑。

围绕 Orca-2-13B 和 GPT-4 Turbo 的讨论强调了这两种方法的优缺点。开源人工智能非常适合推动创新,但它可能会导致许多类似的项目分散资源。专有的人工智能可能会给我们带来更精致、更安全的产品,但它可能缺乏让人们感到舒适的开放性。

要考虑的另一件重要事情是可访问性。对于世界各地的开发人员来说,开源 AI 通常更容易上手,这意味着更多的人可以带来新的想法和改进。然而,如果没有严格的质量检查,开源人工智能可能并不总是可靠的。

经过多次争论,似乎对开源 AI 模型 Orca-2-13B 略有偏好。一个更具包容性、创造性和开放性的人工智能世界的想法真的很有吸引力。但同样清楚的是,我们需要拥有强大的社区和良好的质量检查,以确保开源人工智能保持在正确的轨道上。

对于那些对开源 AI 感兴趣的人,有一个 GitHub 存储库可用,其中包含实验的所有详细信息。它甚至包括有关如何使用开源模型的指南。对于任何想要深入研究人工智能并参与正在进行的关于人工智能发展方向的对话的人来说,这都是一个很好的机会。

开源和专有 AI 模型之间的争论不仅仅是关于代码。这是关于决定我们想要如何塑造人工智能的发展。无论你是喜欢在开源世界中合作的想法,还是喜欢专有 AI 的结构化环境,很明显,这两种做事方式都将对构建一个熟练、安全和值得信赖的 AI 未来产生重大影响。